ChatGPTでファイルをアップロードすると、そのデータがOpenAIのモデル学習にどのように利用されるのか、不安に感じる方も多いでしょう。具体的には、個人向けプランとビジネス向けプランで取り扱い方針が異なるため、これらの違いを正確に理解しておくことが重要です。

本記事では、公式ヘルプに基づいてアップロードしたファイルがモデルの学習に活用される可能性や、プライバシー保護の取り組みについて解説します。

目次

ChatGPTは膨大なデータを学習している

ChatGPTを含む大規模言語モデル(LLM)は、膨大なテキストデータを取り込むことで自然な言語理解と文章生成を行う仕組みです。インターネット上の公開情報やライセンスされた各種データセットが学習に利用され、その結果として多様なトピックについて対応できるようになっています。

しかし、こうした学習の過程で利用されるデータには、ユーザーがアップロードしたファイルやテキスト入力も含まれ得ます。どのデータが学習に活用されるかは、提供されているサービスの種類や契約プラン、オプトアウトの設定状況などに左右されます。

このため、機密情報や個人情報がモデル学習に使われないように管理したり、利用ポリシーを理解したりすることが重要になります。ここからは、ChatGPTにアップロードしたファイルがどのように扱われるのかを見ていきましょう。

個人向けのデータ利用

ChatGPTやDALL·Eなど、主に個人向けサービスを利用している場合は、アップロードしたコンテンツがモデルの改善に使用される可能性があります。

該当する利用シーンの例

ChatGPT無料プラン、ChatGPT Plusを個人利用している場合

自分のアカウント内で個人の範囲でファイルをアップロードした場合

OpenAIの[公式ヘルプ](<https://help.openai.com/en/>)では、「個人向けに提供しているサービスでは、ファイルを含むアップロードされたコンテンツをモデル学習に活用する可能性がある」と明言されています。

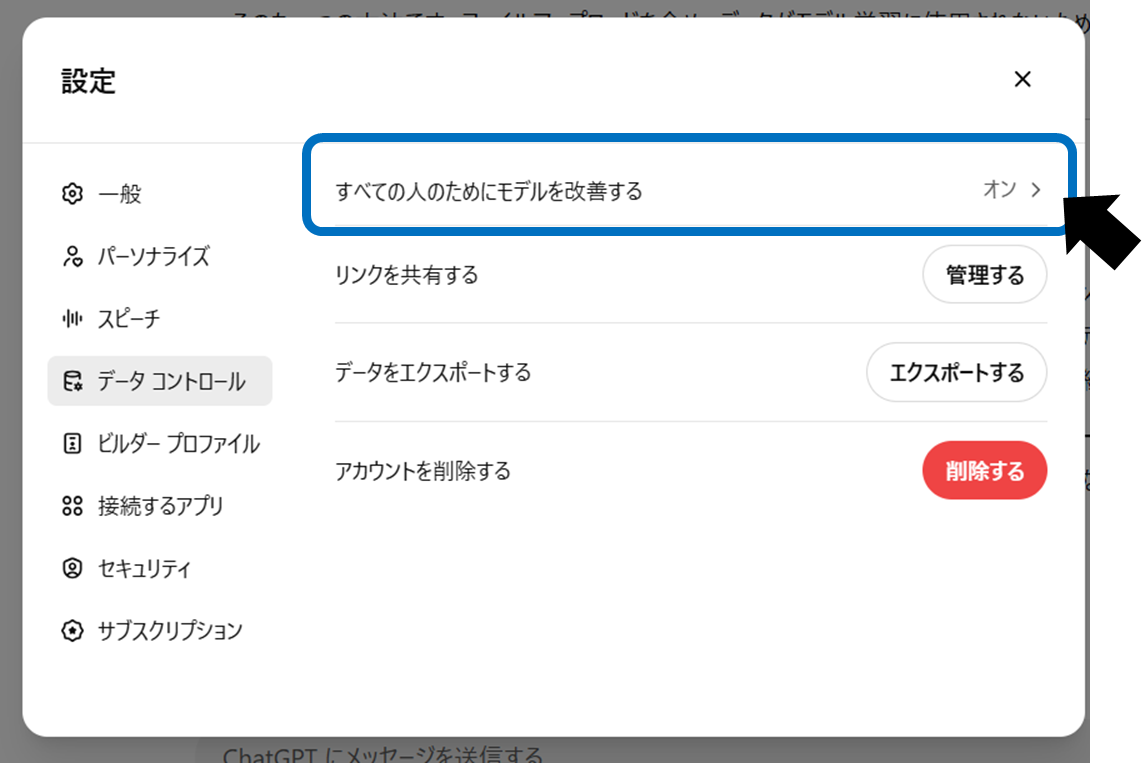

ただし、OpenAIはデータコントロール機能を通じて、ユーザーが自ら設定を管理できる仕組みを提供しています。必要に応じて、ChatGPTの設定から「モデルの学習に利用しない」ようオプトアウトすることも検討しましょう。

ビジネス向けのデータ利用

一方、ビジネス利用を想定したChatGPT EnterpriseやOpenAIのAPI利用の場合は、アップロードされたファイルやテキストがモデルの学習に使われません。

該当する利用シーンの例

ChatGPT Enterpriseを法人契約している場合

OpenAIのAPIを使って自社システムと連携し、独自にファイルやテキストを処理している場合

公式情報によると、企業向けのプランやAPI利用でやり取りされるデータは、モデルの学習には一切使用されないというのがOpenAIの方針です。

これにより、企業の機密情報やユーザーの個人情報が、モデル改善のために他へ転用されるリスクを抑えられます。

アップロードされたファイルが使われる仕組み

アップロードされたデータがどのように処理されるかは、OpenAIが提供するサービスの種類や利用方法によって異なります。

学習への活用ケース

個人向けサービスにおいては、ユーザーがChatGPTにアップロードしたデータや入力したテキストが、OpenAIのサーバー上で保存されたのち、一定のルールや期間に従ってモデル改善に活用されるケースがあります。ただし、これは自動的に行われ、以下のような手法が取られています。

匿名化・集計

ユーザーの個人情報や特定が可能なデータをできるだけ除去し、全体的な傾向をモデル学習に取り入れる

利用規約・プライバシーポリシーの順守

OpenAIが定めるプライバシーポリシーに則り、データがどのように使われるのかを透明化

学習の対象外になる場合

ビジネス向けサービスを利用している場合は、上記のようなデータ学習は行われません。企業側が権威データを扱う際は、この点がセキュリティ上の大きなメリットと言えます。

プライバシー保護のためにできること

ChatGPTを利用する際、個人情報や機密情報がどのように扱われるかを理解することが、安心してサービスを活用するための第一歩です。次に、データを守るために実践できる具体的な対策をいくつかご紹介します。

権威情報の扱いに注意する

たとえ個人向けChatGPTを使う場面であっても、意図せず機密性の高い情報や個人情報を含むファイルをアップロードしないようにしましょう。特に、契約書やID情報、研究データの原文などはアップロード前に内容を吟味することが大切です。

アカウント設定で学習オプトアウトを検討する

ChatGPTの設定画面では、ChatGPTでのデータ使用に関する選択肢が提供されています。情報が機密に近い場合は、データの利用をオプトアウトすることで、学習への利用を制限できます。 設定画面の「データコントロール」タブにある「すべての人のためにモデルを改善する」から「オン」「オフ」を切り替えることができます。

ビジネス版・APIの利用を検討する

会社や組織で高度なプライバシー保護が必要なケースでは、ChatGPT EnterpriseやOpenAI APIの導入を検討するのも一つの方法です。ファイルアップロードを含め、データがモデル学習に使用されないため、安心して運用できます。

まとめ

ChatGPTでアップロードしたファイルやテキストが学習に使われるかどうかは、個人向けプランかビジネス向けプランかによって大きく異なります。個人向けのChatGPTでは、ユーザーがアップロードしたファイルがモデル改善に活用される可能性がありますが、企業向けのEnterpriseプランやAPIではデータが学習に使われない仕組みになっています。

プライバシーや機密情報をしっかり守りたい場合は、機微な情報を含むファイルをアップロードしないことや、設定画面から学習へのデータ利用をオプトアウトすること、あるいはビジネス向けサービスを利用するなどの選択肢を検討しましょう。こうした方針を知っておくことで、ChatGPTをより安心して活用できるはずです。